UNIST, 눈동자 움직임으로 로봇팔 제어하는 스마트 콘택트렌즈 개발

기사입력 2026.04.15 16:41

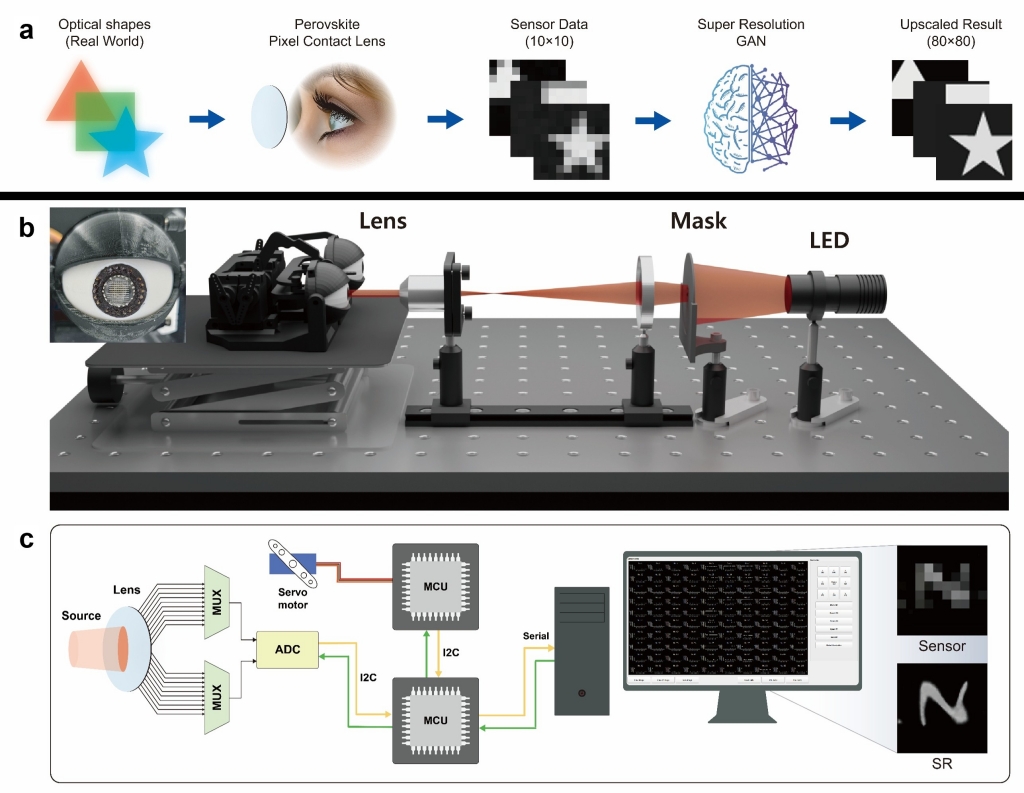

렌즈 위 100개 광센서와 AI 신호 복원 결합

안구 모형 실험서 방향 인식 정확도 99.3%

UNIST에 따르면 이번 연구 결과는 2026년 3월 재료과학 분야 학술지 Advanced Functional Materials에 게재됐다. 논문 제목은 ‘Meniscus Pixel Printing for Contact-Lens Vision Sensing and Robotic Control’이다.

이 스마트 콘택트렌즈는 렌즈 위에 집적된 10×10 배열의 광센서 100개를 통해 눈의 움직임에 따라 달라지는 빛 분포를 읽어 시선 방향을 추적하는 방식으로 작동한다. 위·아래·좌·우는 물론 대각선까지 구분할 수 있고, 깜박임은 별도 명령으로 인식해 로봇팔이 물체를 집는 동작까지 수행하도록 설계됐다.

연구팀은 곡면인 렌즈 표면에 센서를 직접 구현하기 위해 ‘메니스커스 픽셀 프린팅(MPP)’ 기술을 적용했다. 마스크나 복잡한 다단계 공정 없이도 곡률이 있는 표면에 센서 패턴을 형성할 수 있어, 기존 평면 중심 제작 방식의 한계를 줄이는 데 초점을 맞췄다.

좁은 렌즈 면적 탓에 발생하는 낮은 신호 해상도는 인공지능으로 보완했다. 실제 센서는 100개지만, 딥러닝 기반 초해상도 복원 모델을 통해 10×10 입력을 80×80 수준의 광학 정보로 재구성했고, 지연 시간은 0.03초로 제시됐다.

안구 모형을 활용한 실험에서는 눈동자 움직임만으로 로봇팔이 물체를 집어 옮기는 동작이 구현됐다. 연구팀은 9개 방향의 시선 제스처 인식 정확도가 99.3%였다고 밝혔다. 이는 렌즈처럼 작은 장치 안에서도 센서 공정과 AI 신호 복원 기술을 결합해 제어 성능을 확보할 수 있음을 보여주는 결과로 읽힌다.

이번 연구의 제1저자는 공병훈, 김도현 연구원이며, 논문 저자로 정임두 교수가 함께 이름을 올렸다. 연구는 한국연구재단 등 정부 지원을 받아 수행됐다.

관련 웨비나

많이 본 뉴스

[열린보도원칙] 당 매체는 독자와 취재원 등 뉴스이용자의 권리 보장을 위해 반론이나 정정보도, 추후보도를 요청할 수 있는 창구를 열어두고 있음을 알려드립니다.

고충처리인 장은성 070-4699-5321 , news@e4ds.com

.png)